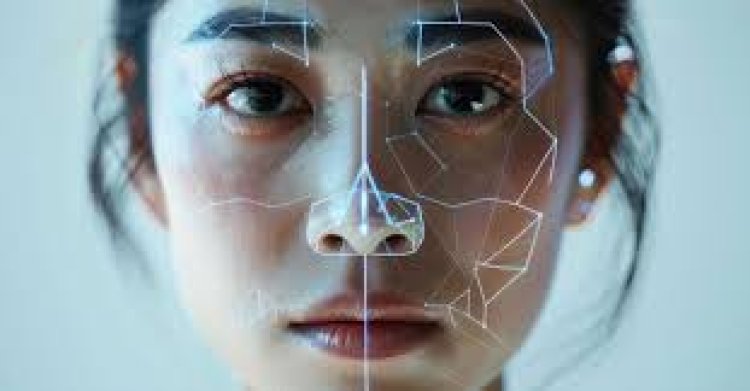

Fenomena "Deepfake" AI di Media Sosial: Pakar Ingatkan Bahaya Penipuan Modus Video Call

Laporan mengenai tren bahaya teknologi Deepfake AI yang digunakan untuk modus penipuan video call dan himbauan pakar keamanan siber per April 2026.

(Batam24.com) | JAKARTA – Jagat maya Indonesia sedang dihebohkan oleh tren teknologi Deepfake berbasis Kecerdasan Buatan (AI) yang semakin canggih dan sulit dibedakan dari aslinya. Per Selasa, 14 April 2026, sejumlah laporan warga mencuat mengenai modus penipuan baru yang menggunakan wajah dan suara kerabat dekat untuk meminta sejumlah uang melalui video call. Teknologi ini mampu memanipulasi ekspresi wajah secara real-time, sehingga korban seringkali tidak menyadari bahwa mereka sedang berbicara dengan program komputer, bukan dengan sosok asli yang mereka kenal.

Pakar keamanan siber dari BSSN menghimbau masyarakat untuk lebih waspada dan menerapkan "kode rahasia" keluarga saat menerima panggilan video yang mencurigakan atau meminta transaksi finansial mendadak. Selain digunakan untuk penipuan, tren deepfake ini juga memicu perdebatan mengenai etika digital dan perlindungan data pribadi, mengingat foto-foto yang diunggah secara publik di media sosial dapat dengan mudah diambil dan diolah oleh oknum tidak bertanggung jawab. Pemerintah kini tengah menggodok regulasi lebih ketat terkait penggunaan AI guna melindungi warga dari ancaman disinformasi dan kejahatan digital yang semakin mutakhir ini.

(Dykha)